AI 칩이 빨라질수록 컴퓨터는 느려진다? 2026년 반도체 설계자들이 숨기고 있는 역설

당신의 최신 노트북이 이전 세대보다 CPU 성능이 40% 높다고 광고하지만, 실제 체감 속도는 오히려 답답하다고 느껴본 적 있나요? 이건 당신의 착각이 아닙니다. 오히려 반도체 업계가 지난 15년간 저지른 근본적인 실수 때문입니다.

2026년 현재, 우리가 당연하게 믿는 "칩이 빠르면 컴퓨터도 빠르다"는 법칙이 이미 깨져 있습니다. 인텔과 AMD, 애플이 내놓는 최신 프로세서들은 GHz 수치상으로는 점점 높아지지만, 메모리와 칩 사이의 통신 병목이 점점 심해지고 있기 때문입니다. 이를 "메모리 월(Memory Wall)"이라 부르는데, 이건 2000년대부터 예견된 문제인데도 아무도 근본적으로 해결하지 못했습니다.

칩의 역설: 빠를수록 짜증난다는 과학적 증거

최신 노트북의 CPU는 나노초(10억 분의 1초) 단위로 계산을 수행합니다. 그런데 메모리에서 데이터를 가져오는 데는 수백 나노초가 걸립니다. 비유하면, 레이서가 시속 300km로 달리는데 휴게소까지의 거리가 변하지 않은 것과 같습니다. 아무리 빨리 달려도 결국 멈춰야 하는 지점은 그대로인 셈이죠.

NVIDIA와 삼성전자의 HBM(고대역폭 메모리) 기술이 등장한 이유가 바로 이겁니다. 2024년 이후 AI 칩들은 CPU 성능보다 '메모리 접근 속도'에 훨씬 더 많은 에너지와 비용을 쏟기 시작했습니다. 실제로 최신 H100 GPU는 전체 전력의 70% 이상이 메모리 대역폭 확보에 소비됩니다.

당신이 모르는 숨겨진 측정 지표

제조사들은 절대 이야기하지 않지만, 진정한 성능은 'FLOPS(초당 부동소수점 연산 수)'가 아닌 'GB/s(초당 기가바이트 전송량)'로 결정됩니다. 당신의 2026년형 노트북 CPU가 10 TFLOPS를 자랑해도, 메모리 대역폭이 100 GB/s에 머물러 있다면, 실제로는 수 년 전 메모리 대역폭이 같은 구형 칩만큼만 빠르다는 의미입니다.

설계자들이 택한 위험한 도박: 캐시의 악순환

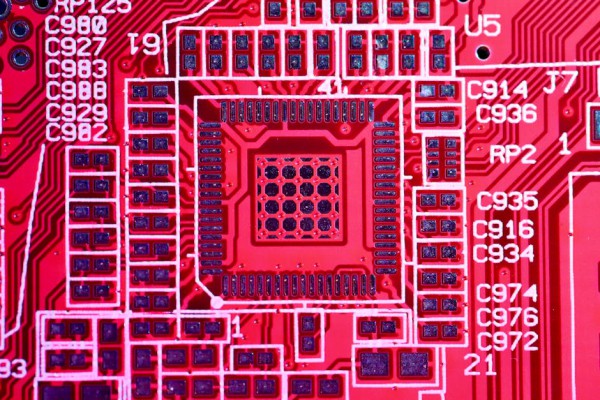

칩 제조사들이 찾은 임시 해결책이 '캐시'입니다. 칩과 가까운 곳에 작은 저장 공간을 만들어 자주 쓰는 데이터를 미리 저장해두는 방식인데, 이게 점점 비대해지고 있습니다. 2000년 펜티엄 4는 256KB 캐시였지만, 2026년 인텔 코어 울트라는 개별 코어당 64MB에 달합니다. 250배 증가한 것입니다.AI

하지만 이건 근본 해결이 아닙니다. 캐시가 커질수록 CPU의 전체 면적에서 '실제 계산하는 부분'의 비중은 줄어들기 때문입니다. 마치 창고 건물의 95%가 보관함이고 5%만 실제 일하는 공간인 셈입니다. 더욱 문제는 캐시 미스(필요한 데이터가 캐시에 없을 때)가 발생하면 성능이 급격히 떨어진다는 점입니다.

2026년 AI 시대가 드러낸 숨겨진 병목

LLM(대규모언어모델)이 대중화되면서 역설이 드러났습니다. ChatGPT는 초당 수조 번의 연산을 하지만, 대부분의 시간을 '데이터를 메모리에서 꺼내는 것'에 씁니다. 구글의 연구진이 발표한 논문에 따르면, 최신 트랜스포머 모델의 경우 연산 대비 메모리 접근 비율이 1:100을 넘습니다. 즉, 100번 기다려야 1번 계산한다는 뜻입니다.

당신이 사용하는 노트북도 동일한 문제를 겪고 있습니다. 웹 브라우징, 문서 작업, 이미지 편집—모든 작업이 실은 CPU가 아닌 '메모리 시스템'의 속도에 좌우됩니다. CPU 성능이 아무리 올라가도 메모리 시스템이 따라가지 못하면, 칩의 대부분은 무의미하게 기다리고만 있는 것입니다.

그렇다면 앞으로 컴퓨터는 정말 더 느려질까요? 아니면 완전히 다른 방식의 칩 구조를 발명할까요? 지금 삼성, 인텔, TSMC가 개발 중인 3D 스택 메모리와 포토닉 칩이 이 역설을 깨뜨릴 수 있을까요?